Expertos internacionales alertaron mediante un informe sobre los riesgos de un uso malintencionado de la inteligencia artificial por parte de “Estados corruptos, de criminales o de terroristas” en un futuro cercano.

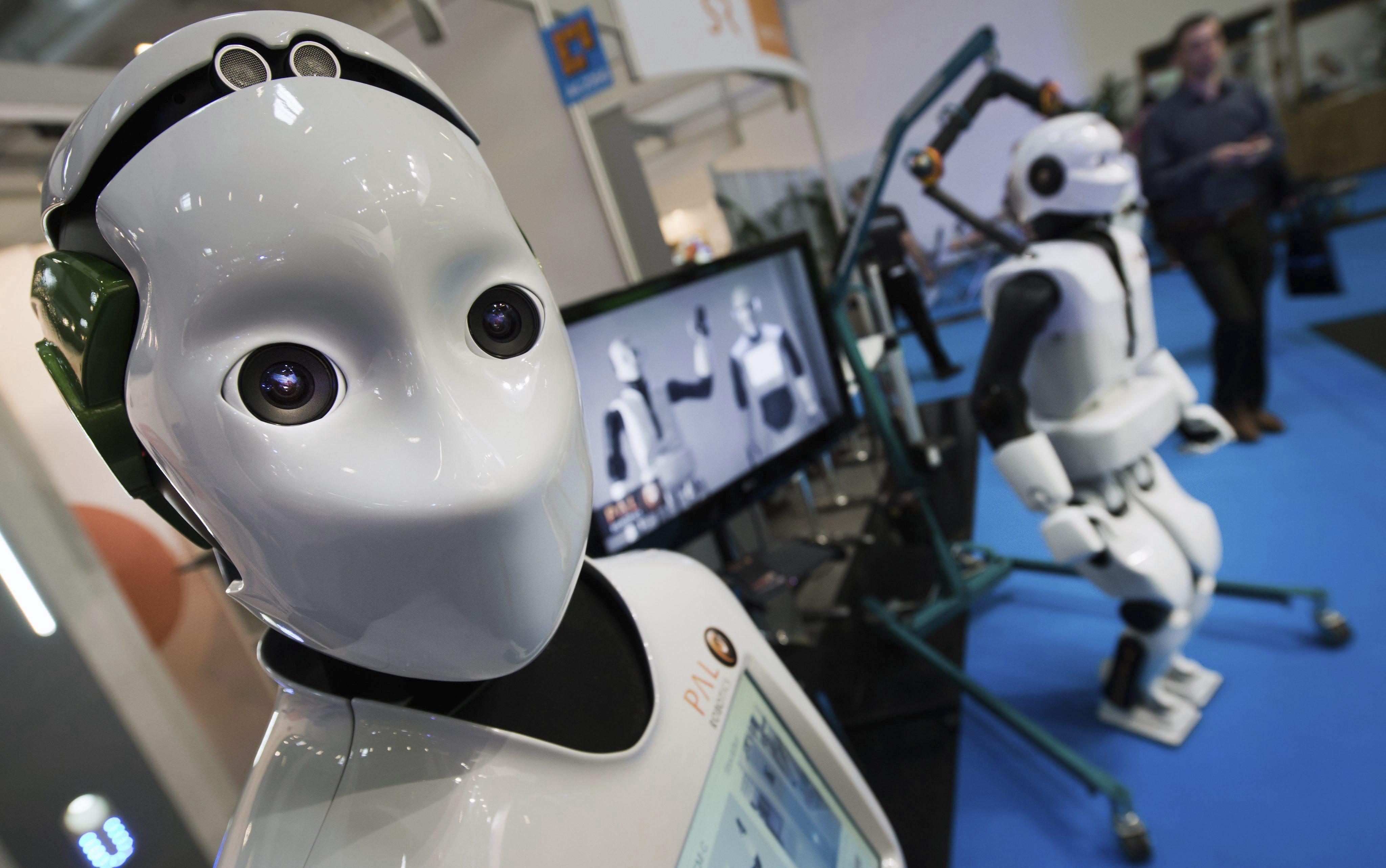

Según ellos, en la próxima década, la eficacia creciente de la inteligencia artificial (IA) podría reforzar la cibercriminalidad y conducir al uso de drones o robots con fines terroristas. Podría también facilitar la manipulación de elecciones a través de las redes sociales mediante cuentas automatizadas (bots).

Este extenso informe de 100 páginas fue redactado por 26 expertos especialistas en IA, ciberseguridad y robótica de prestigiosas universidades (Cambridge, Oxford, Yale, Stanford) y organismos no gubernamentales (OpenAI, Center for a New American Security, Electronic Frontier Foundation).

Estos expertos piden a los gobiernos y a los diferentes actores de este campo que pongan en pie mecanismos para limitar las posibles amenazas relacionadas con la inteligencia artificial.

“Creemos que los ataques que serían posibles por el uso creciente de la inteligencia artificial serán particularmente efectivos, finamente dirigidos y difíciles de atribuir”, advierten.

Para ilustrar sus temores, estos especialistas mencionan varios “escenarios hipotéticos de usos malintencionado de la IA”.

Explican por ejemplo que terroristas podrían alterar los sistemas de inteligencia artificial disponibles en los comercios (drones o vehículos autónomos) para causar accidentes o explosiones.

Los autores imaginan también casos de robots de limpieza traficados que se colarían entre otros robots encargados por ejemplo de la limpieza de un ministerio. Un día, el intruso podría atacar tras localizar visualmente al ministro. Se acercaría a él y se haría estallar, detallan.

Vídeos falsos

Por otra parte, Seán Ó hÉigeartaigh, uno de los autores del estudio, explica, en entrevista dijo, que “la cibercriminalidad, en fuerte alza, podría consolidarse con herramientas facilitadas por la inteligencia artificial”.

Por ejemplo, los ataques denominados de spear phishing (ataques dirigidos a una organización o empresa para robar por ejemplo información confidencial) podrían ser más fáciles de llevar a cabo a una escala mayor.

Pero para él, “el riesgo más grande, aunque es menos probable, es el riesgo político”. “Ya hemos visto cómo algunas personas están usando la tecnología para tratar de interferir en elecciones”, apunta.

Con la IA sería posible, por ejemplo, realizar videos falsos pero muy realistas que podrían ser utilizados para desacreditar a responsables políticos, afirman los expertos.

Los Estados autoritarios, agrega el informe, podrían también apoyarse en la inteligencia artificial para vigilar a sus ciudadanos.

Múltiples advertencias

No es la primera vez que expertos lanzan una señal de alarma sobre este tipo de tecnología avanzada. En 2014, el astrofísico Stephen Hawking advirtió sobre los riesgos que la inteligencia artificial podría hacer correr a la humanidad si supera la inteligencia humana. El empresario Elon Musk y otros también han multiplicado las advertencias.

https://youtu.be/mOLFwg5ljHM

También se han publicado informes sobre el uso de drones asesinos o sobre la manera en la que la IA podría afectar a la seguridad de países como Estados Unidos.

Con información de AFP.